StabilityMatrixは画像生成AIのStable Diffusionを、PythonやGitを別途インストールする必要無く手軽で簡単に導入する事が出来るオープンソースのソフトウェアです。Stable Diffusionの導入だけでなく操作画面となるStable Diffusion WebUI(AUTOMATIC1111)やComfyUI、FooocusといったUI環境、Checkpoint(画風に影響するモデル)のダウンロードや更新、削除といった管理も簡単に行う事が出来ます。

元々筆者はStabilityMatrixからStable Diffusionを始めたので、一から環境を構築する難しさや面倒さは分からない為に比較は出来ませんが、ハードルの高い印象だったAIによる画像生成がStabilityMatrixで思いの外簡単に実現出来ました。現在ではWindowsに標準で付属するCopilotでも画像生成は出来ますが、クラウド上での生成と異なりローカルでの生成ではGPUの性能次第ではあるものの、比較的に早く生成出来る他に規制を気にする事なく自由な画像を生成させる事が出来ます。

動作環境はWindows 11/10の他、LinuxとmacOS用が開発されています。更にSSDの空き容量が20GB以上(実際にはもっと必要)、メモリ12GB以上、VRAM 4GB以上のNVIDIAかAMDのビデオカードが必要ですが、記事を書いている時点ではAMDのGPUは実験段階との記載があります。

筆者が使用している環境

- CPU: Ryzen 5 5600

- GPU: GeForce RTX 3060(VRAM 12GB)

- メモリ: 16GB×2(計32GB)

- ストレージ: SSD 約1000GB

筆者は元々パソコンゲームを殆どしないのでビデオカードは要らない派だったのですが、Topaz Video AIで古いビデオをアップスケーリングしたりAIによる画像生成で遊んでみたくて入門用に丁度良いと評判のGeForce RTX 3060を購入しました。このクラスのGPUだと何枚かの低解像度の画像を生成する分には悪くないのですが、お気に入りが出るまで繰り返し大量に生成させるには性能不足を感じます。

ストレージの空き容量は公式では20GB以上となっていますが、複数のCheckpointや拡張他、色々と後から追加していくとかなりの容量になります。筆者の場合は現在約40GBの容量となっていますが、可能な限りSSDの空き容量を確保しておいて下さい。

StabilityMatrixのダウンロードとインストール

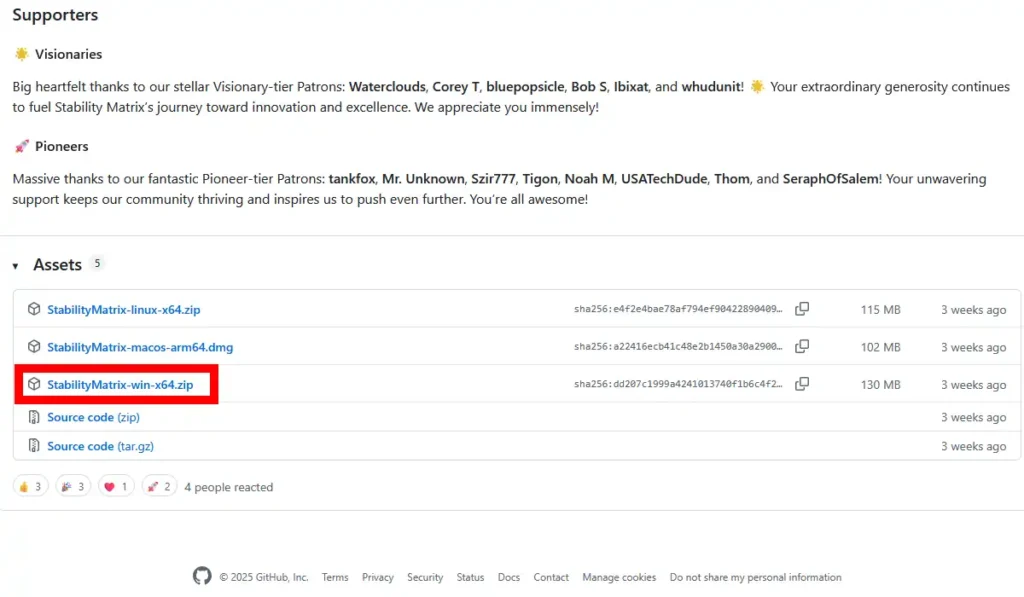

StabilityMatrixは公式サイトのLykosAIのダウンロードページの他、GitHubからダウンロード出来ます。筆者はGitHubからダウンロードしました。

ダウンロード後、圧縮ファイルを展開して中身の「StabilityMatrix.exe」を実行。非推奨環境の場合のみ?「さあ、始めよう」という画面が表示されます。下部にある約款の同意にチェックが入っているのを確認して「続ける」で進みます。

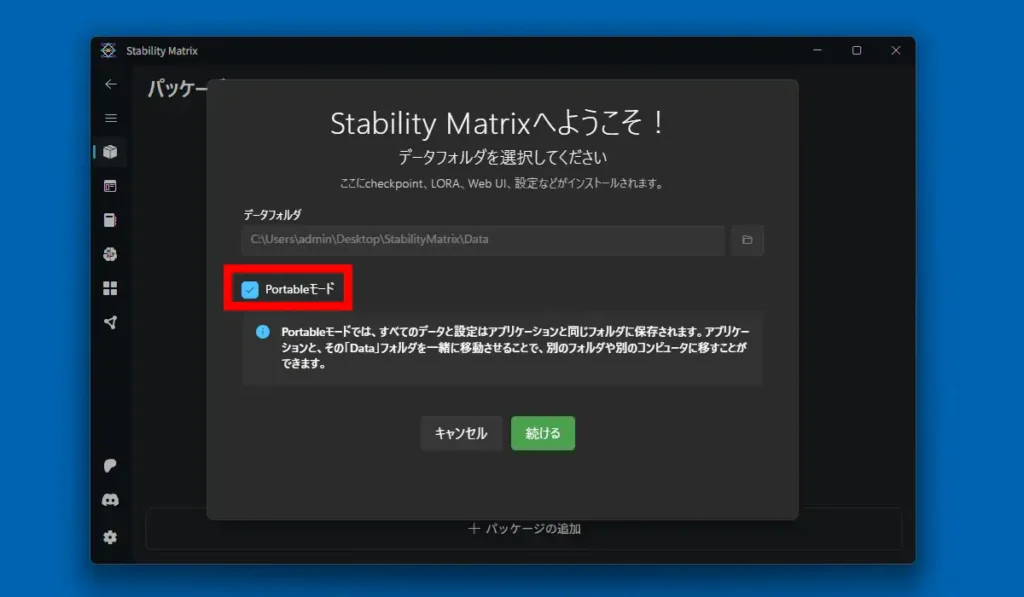

ようこそ画面が表示されます。「Portableモード」にチェックを入れておくのがお勧め。動作に必要なファイルは実行ファイルのあるフォルダ内にダウンロードされ、説明にある通り自由にフォルダを移動する事が出来るようになります。「続ける」で進みます。

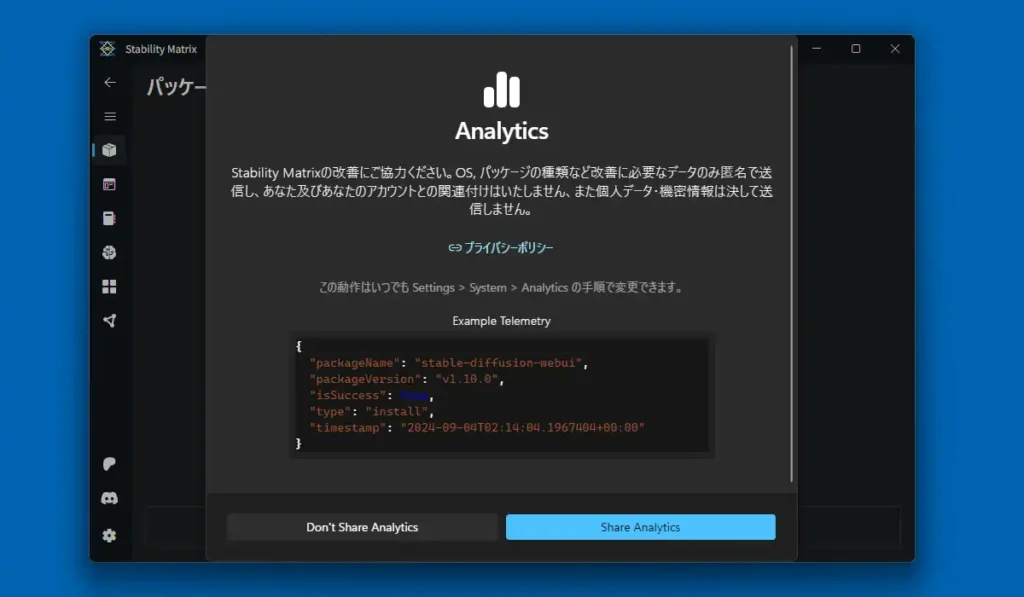

Analyticsの画面では使用状況を匿名で送信するかを選択します。「Share Analytics」で共有、「Don’t Share Analytics」で拒否します。どちらを選ぶかはお好みですが、筆者はこの類の選択はいつも拒否しています。

リストの中から初期インストールするUIを選択します。ここで選択した物がStable Diffusionの操作画面になりますが、後からでも追加可能です。定番としてはStable Diffusion WebUI(AUTOMATIC1111)ですが、現在ではRecommended(推奨)となっているStable Diffusion WebUI Forgeの方が良さそうです。標準のWebUIよりVRAM消費が少なくなって効率化したと噂なので今回はWebUI Forgeを選択して進めました。

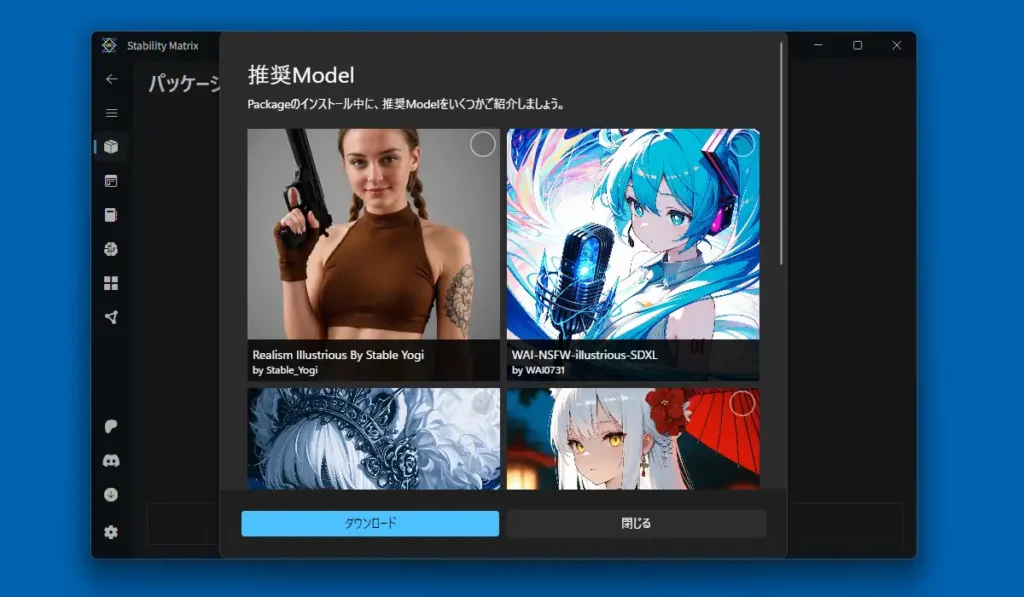

推奨Modelが表示されますが、Modelのデータもかなりの容量があるのでここではダウンロードせず、「閉じる」でこの画面を閉じます。

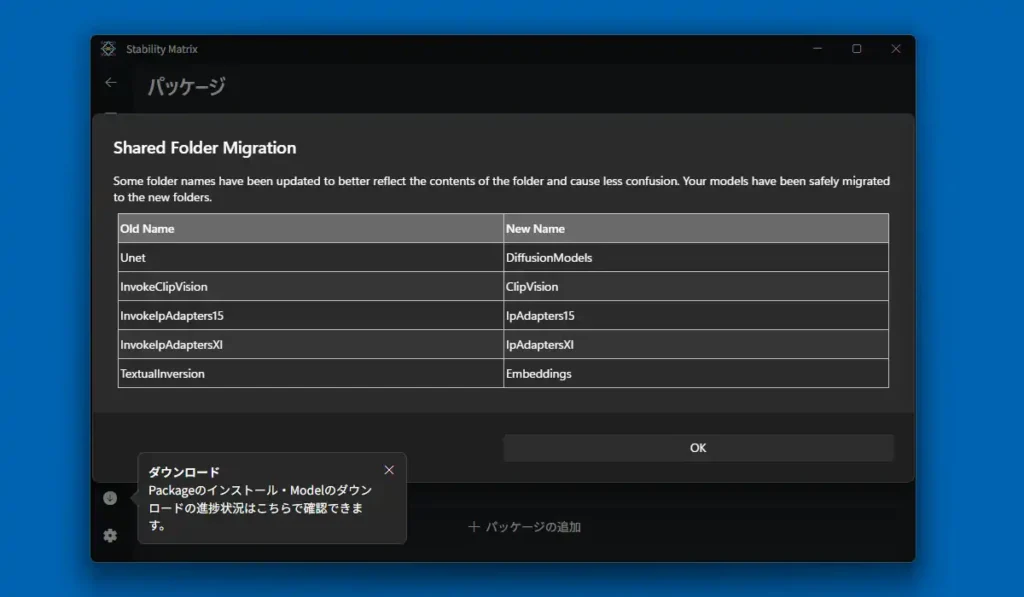

Shared Folder Migrationという画面が表示されますが、要約すると混乱を軽減する為にフォルダ名を変更したという内容になっており名前が変更されたフォルダが表示されます。「OK」でこの画面を閉じます。

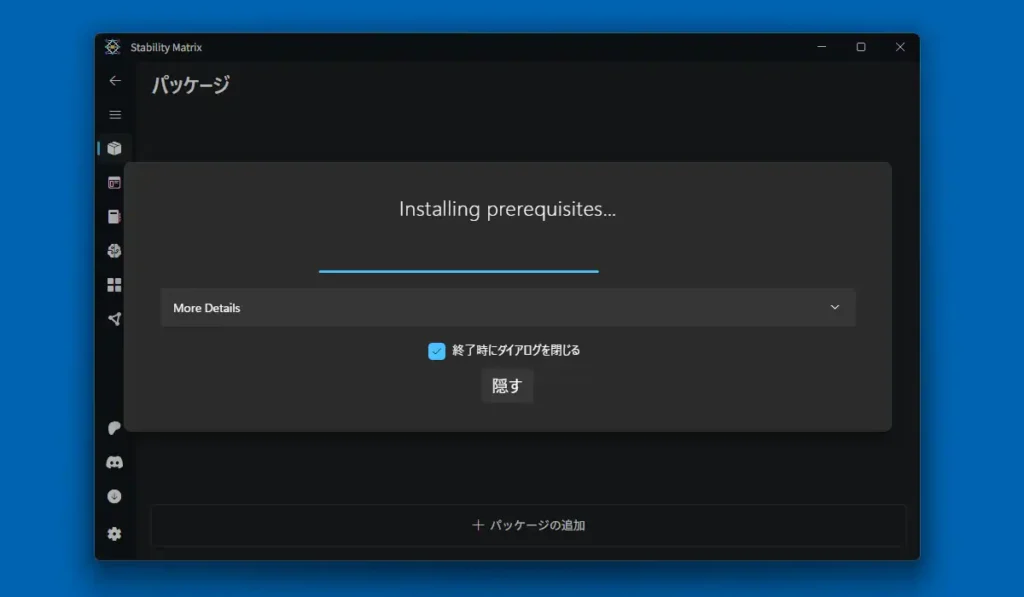

インストール画面が表示されます。途中「Visual Studio Installer」のインストール許可を求める画面が表示されるので「はい」で許可します。ここから先、かなり長い時間ダウンロードが行われますが、筆者の環境では完了するまでに約25分かかりました。

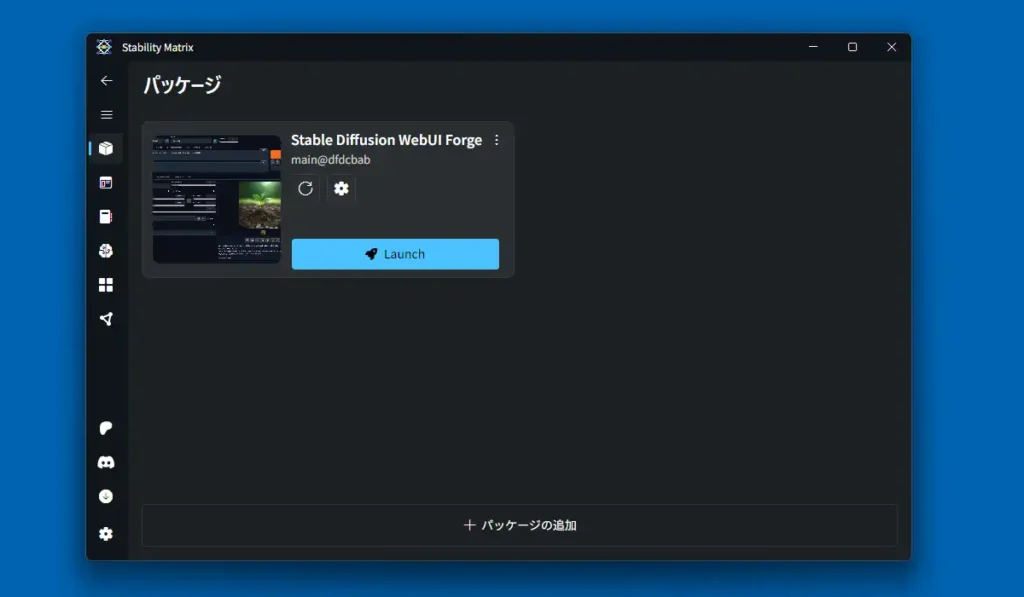

完了するとStabilityMatrixのメイン画面が表示されます。また、画面内にはインストール時に選択したUIが表示されている筈ですが、下部にある「+パッケージの追加」から新たにUIを追加インストール出来ます。

StabilityMatrixからStable Diffusionを動かす

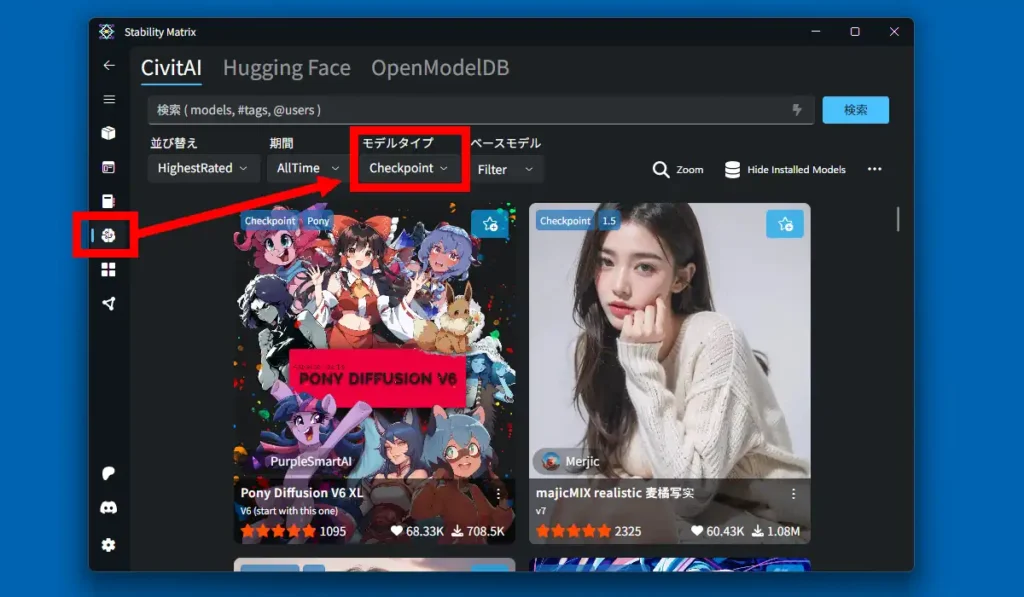

早速「Launch」から起動させたい所ですが現在のバージョンだとモデルが1つもない状態なので、先に画面左端にある「Model Brouser」のボタンから「CivitAl」に接続してモデルをダウンロードします。「モデルタイプ」が「Checkpoint」になっているのを確認。

画面内に表示された中から好みの画風を探してクリック後、「インポート」でダウンロードが始まります。今回は「majicMIX realistic」をダウンロードしますが、他に実写系で日本人含むアジア人の画像を生成したい場合は「Beautiful Realistic Asians」辺りもお勧めです。

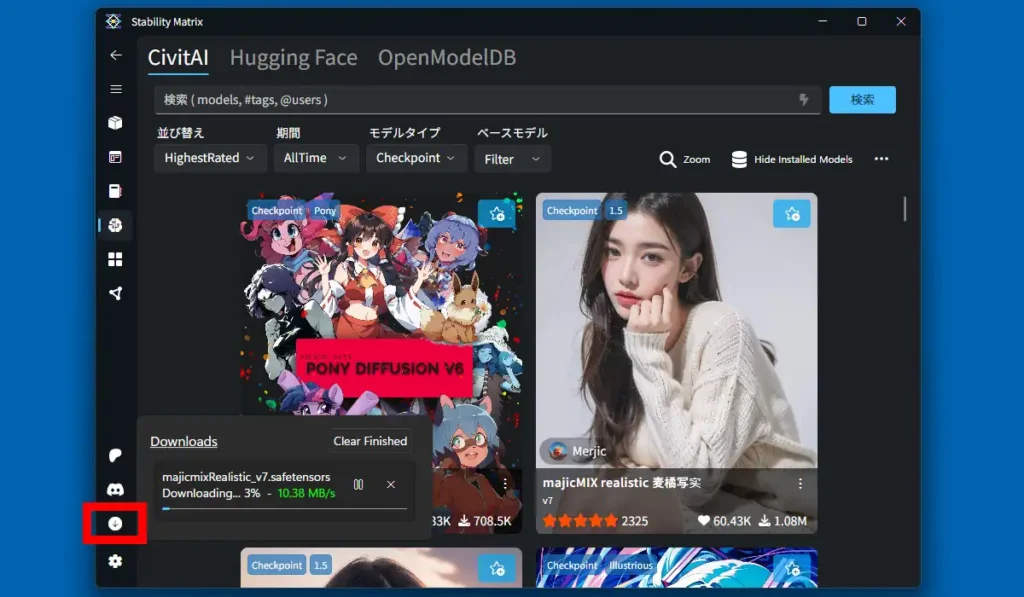

インポートボタンクリック後、何も変化が無いように見えますが、画面左端下にダウンロードボタンが表示されるので、これをクリックすると進捗情報が表示されます。ファイルは約2GBあるので完了まで時間が掛かりますが、完了すると「Completed」となります。

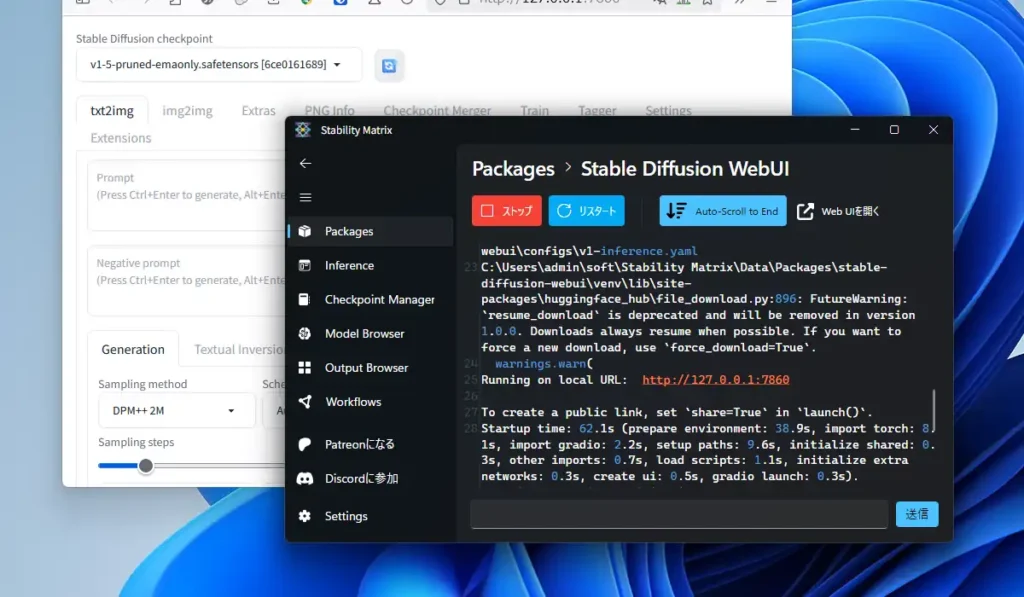

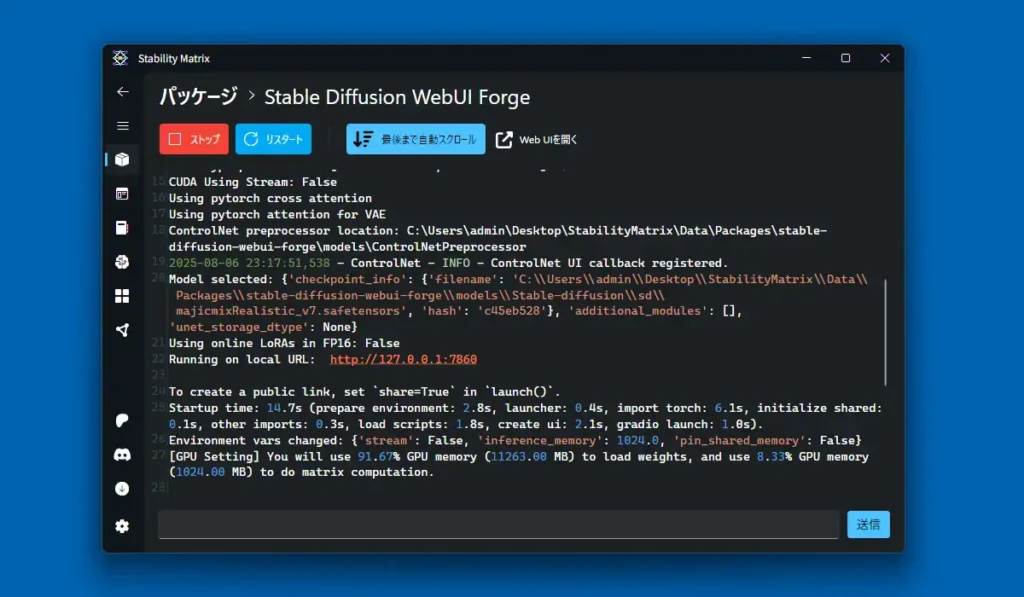

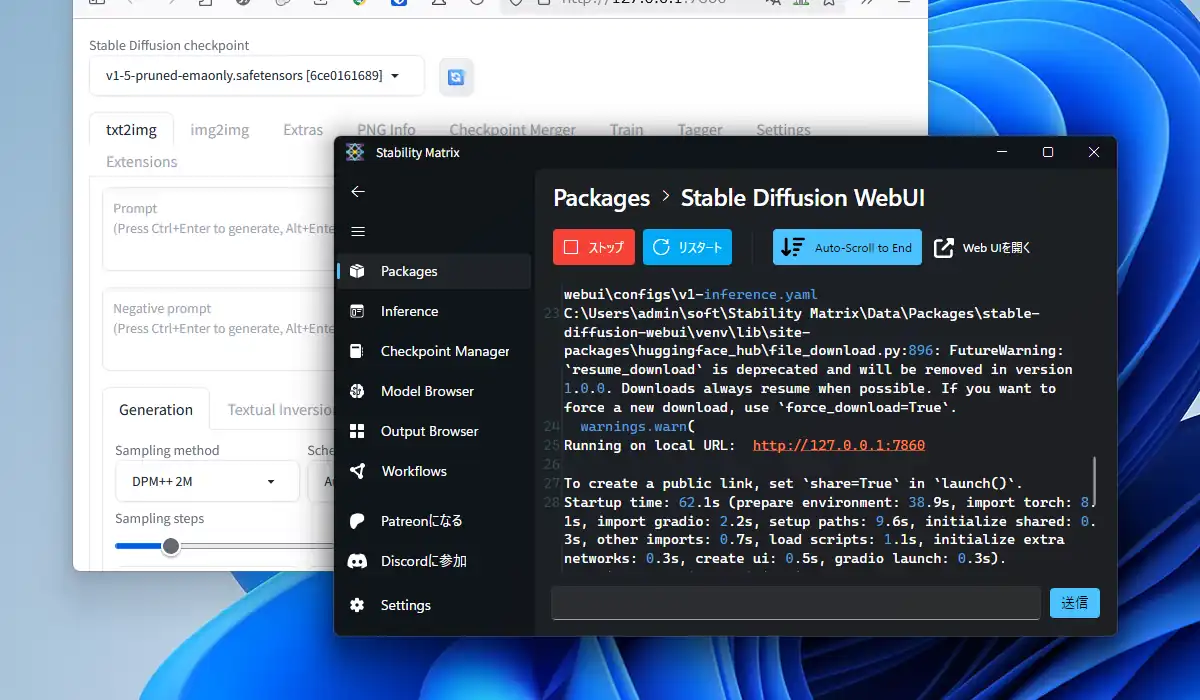

初期画面に戻り「Launch」からUIを起動します。最初にコマンド画面が表示され、一時待っているとWebブラウザで操作画面が表示されます。初回起動時は少し時間が掛かるのと筆者の環境では途中で「ValueError…」と表示され起動出来ませんでしたが、「リスタート」ボタンから再実行して起動する事が出来ました。

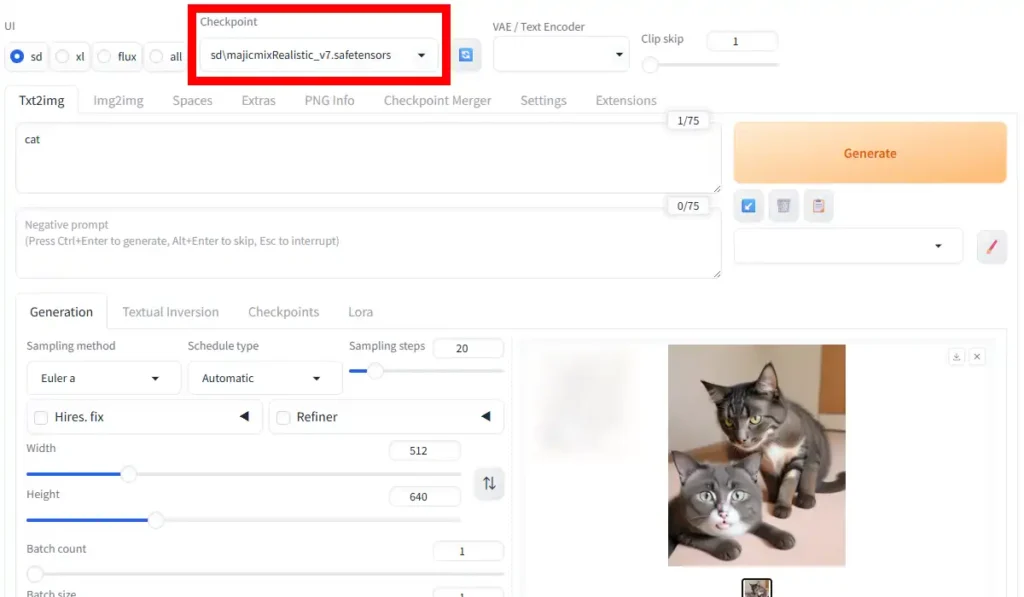

正常に動作するかのテストとして適当な画像を生成してみます。まず「Checkpoint」の欄で正常にモデルが選択されているかを確認。複数のモデルをインストールしている場合は、ここから切り替える事が出来ます。「Prompt」の欄に生成させたい物を入力、逆に「Negative prompt」の欄には生成させたくない物を入力します。今回は単純にcatと入れて「Generate」ボタンから生成してみました。

「Prompt」や「Negative prompt」は日本語でも一応は動作しましたが、基本的には英語を使って入力する方が確実なようです。複数の要素を入力する場合は「cat,brown」といった具合にカンマで区切って入力します。また、生成された画像はStabilityMatrix内の「Images」フォルダ内に保存されます。生成された画像のサムネイルの下にあるフォルダアイコンのボタンから開く事が出来ます。

他、基本的な操作として「Sampling method」は筆者も詳しく説明は出来ませんが生成のアルゴリズムを変える事が出来ます。思い通りの物が生成されない場合は別の物に変えてみて下さい。「Euler a」が高品質な物が生成されやすく定番となっています。それ以外では「Width」で横のサイズ、「Height」で縦のサイズを指定、「Batch count」で生成数を指定出来ます。1枚だけで思い通りの物が生成される事は稀なので5枚や10枚生成して、中から一番良い物を選別するといった使い方になると思います。

StabilityMatrix 備考

StabilityMatrixからStable Diffusionを最低限動作させる所まで書きましたが、思い通りの画像を生成しようとなるとNegative promptがかなり重要になってきます。Stable Diffusionで生成される画像には不自然な物も少なく無く、猫の尻尾が2つあったり人の指が6本あったりといった物も良く生成されます。これらの生成を事前に防ぐ為にはNegative promptで様々な記述をしておく必要があるのですが、筆者も未だに正解は分からないので自身で関連情報を検索して試行錯誤してみて下さい。

他、テキストからの画像生成以外にimg2imgで既存の画像を入力して編集するといった事も出来ます。例えば写真の背景を変えるとか画像内のロゴを消す、人物の衣装を変えるといった事も比較的簡単に行えます。更に拡張を追加して機能を増やすといった事も出来ますがStable Diffusion WebUI Forgeには標準で人気のcontrolnet含め大量の拡張がインストールされています。

コメント